OneDiff 1.0发布!生产环境稳定加速SD/SVD模型

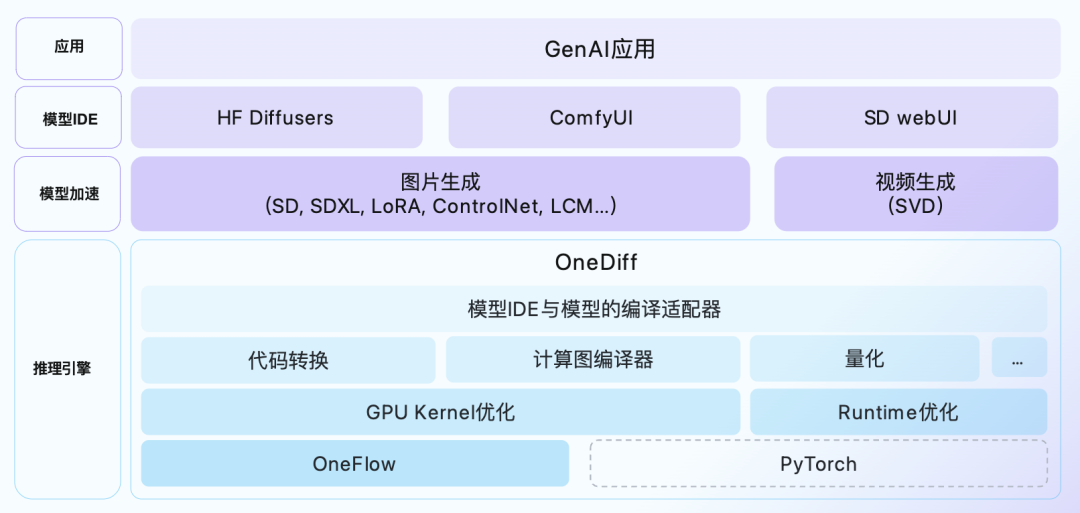

自Stable Diffusion模型发布以来, 硅基流动开发的 OneDiff图片/视频推理加速引擎以其 卓越的性能、“一键”加速的易用性、以及 对最新算法和应用框架的快速支持,深受开发者和用户的喜爱。

今天,OneDiff v1.0.0正式发布。 本次版本更新解决了此前版本v0.13中的问题,主要包括以下新特性、改进以及若干Bug修复:

- OneDiff质量评估

- 重复利用编译图

- 改进对Playground v2.5的支持

- 支持ComfyUI-AnimateDiff-Evolved

- 支持ComfyUI_IPAdapter_plus

- 支持Stable Cascade

- 提高了VAE的性能

- 为OneDiff企业版提供了量化工具

OneDiff的后续版本将专注于DiT/Sora类模型。

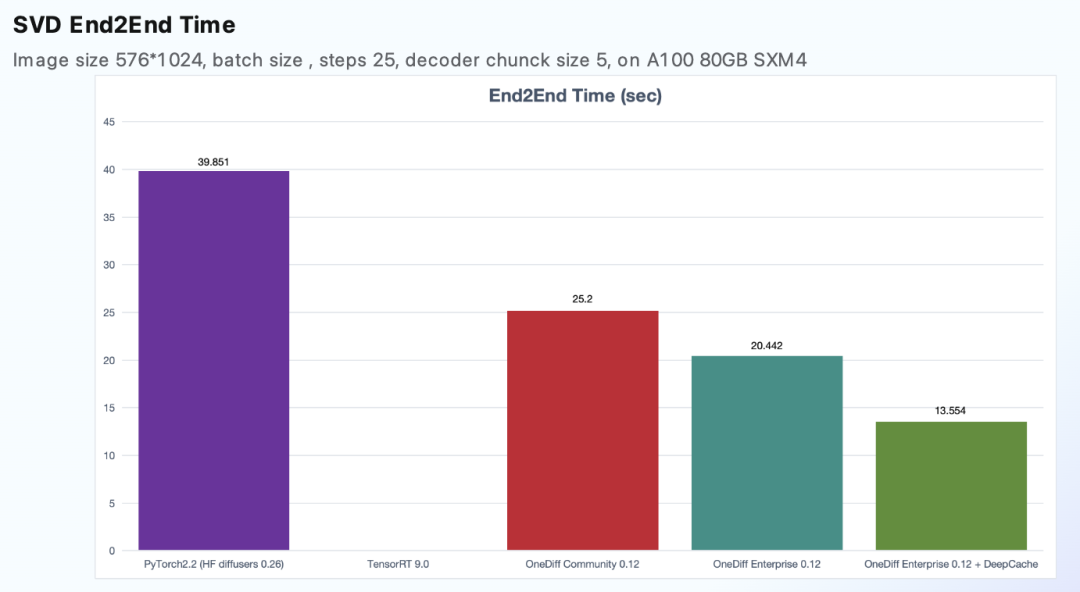

性能方面,无论是Stable Diffusion还是Stable Video Diffusion模型,OneDiff依然保持2~3倍的端到端推理加速。

在OneDiff的加持下,RTX3090甚至可以超越A100的性能,帮助企业和用户大幅节省使用A100的成本。

OneDiff Demo

从默认皮肤灰袍甘道夫到近战法师白袍甘道夫,无论是细节层面“加入法杖”、“骑马”、“加入霍比特人”,还是宏观的场景切换(从Shire到Mordor),随着提示词即时更换,OneDiff 加速库实现图片即时生成(推理时间与端到端时间均小于300ms)。在经过层层嵌套、修改提示词,OneDiff的输出依然稳定(录屏展示无加速)。

应用案例

OneDiff已在多家海内外知名GenAI企业的生产环境中得到应用。

- Stable Diffusion XL优化终极指南(评测报告)

- 百万用户通话新风潮:仅需50秒,无界AI让彩铃变身短视频

- OneDiff加速“图生生”,解锁电商AI图像处理新范式

- 更多案例持续更新中:github.com/siliconflow/onediff/wiki

本文分享自微信公众号 - OneFlow(OneFlowTechnology)。

如有侵权,请联系 support@oschina.cn 删除。

本文参与“OSC源创计划”,欢迎正在阅读的你也加入,一起分享。

|

- 上一条: GreatSQL 死锁案例分析 2024-04-19

- 下一条: 基于LLM大模型Agent的适用范围和困境 2024-04-19

相关文章

- 顶会ICSE-2023发布LIBRO技术,利用大模型技术进行缺陷重现,自动重现率达33% 2023-05-22

- 176万!GPT-4发布了,如何查看OpenAI的下载量? 2023-03-17

- OpenNJet KIC v1.0发布!K8s Ingress Controller 2023-11-22

- StarRocks2.0发布,新一年,新启航,新极速! 2022-01-05

- 易用友好的监控告警系统HertzBeat赫兹跳动v1.0.beta.5发布 2022-03-10

热度排行